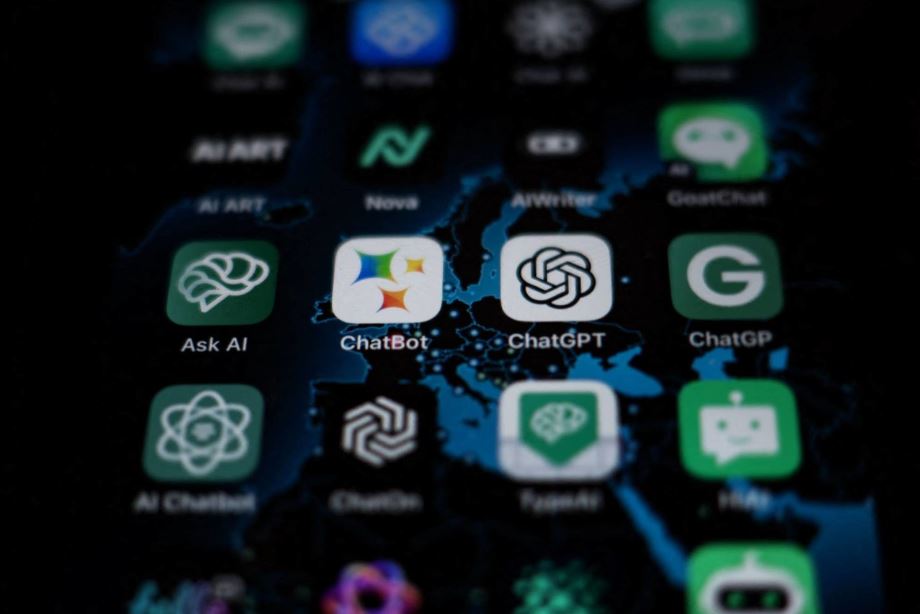

کارفرمایان شرکت های بزرگ فناوری ایالات متحده نگران نفوذ ChatGPT در بین کارکنان خود هستند!

طبق گزارش خبرگزاری رویترز؛ نظرسنجی ها نشان می دهد کار فرمایان شرکت های بزرگ فناوری مانند مایکروسافت و گوگل دسترسی کارکنان به چت بات ChatGPT را محدود کرده اند. آنها نگران نفوذ این فناوری در بین کارمندان خود هستند. به نظر می رسد کارگران زیادی از این چت بات برای انجام وظایف اصلی شان در این شرکت ها استفاده می کنند. بله، بلاخره این بار چاقو برگشت و دسته خودش را برید! زمانی که این شرکت ها در زمینه هوش مصنوعی گرم رقابت بودند نمی دانستند، پیامدهای منفی آن روزی دامن گیر خودشان خواهد شد.

در حال حاضر، شرکت های زیادی در جهان به دنبال روش هایی برای بهبود نحوه استفاده از ChatGPT هستند. ChatGPT در واقع یک چت بات مبتنی بر هوش مصنوعی مولد است که می تواند با کاربران مانند یک انسان مکالمه کند و به درخواست های آنها در مدت زمان کوتاهی پاسخ دهد. با این همه، شرکت های فعال در حوزه امنیت سایبری نگران افشای اطلاعات حساس و نقض مالکیت معنوی توسط آنها هستند.

حوزه استفاده از چت بات شرکت openAI در حال گسترش است. کاربران می توانند از آن برای پاسخگویی سریع به ایمیل ها، خلاصه سازی اسناد و انجام تحقیقات استفاده کنند. در نظر سنجی که رویترز بین 11 تا 17 جولای برگزار کرد حدود 28 درصد از پاسخ دهندگان در محیط کار خود از چت بات استفاده می کنند. 22 درصد از آنها اعلام کردند که کارفرمایان شرکت هایی که در آن مشغول به کار هستند، استفاده از آن را مجاز می دانند. اما، حدود 10 درصد از آنها گفتند که مدیران شرکت هایشان استفاده از آن را ممنوع اعلام کرده اند. در این میان، حدود 25 درصد هم نمی دانستند که شرکت های آنها اجازه استفاده از این فناوری را می دهند یا خیر!

ربات چت OpenAI اندکی بعد از عرضه در ماه نوامبر به یکی از پرطرفدارترین برنامه های حال حاضر در بین کاربران تبدیل شد. این تعداد کاربر هم می تواند هیجان انگیز باشد هم نگران کننده! تا جایی که نهادهای مختلفی از جمله اتحادیه اروپا و طرفداران قوانین حفظ حریم شخصی به نقض آشکار این چت بات اعتراض کرده اند. محققان معتقدند هوش صنوعی جدید و مدل های مشابه آن می توانند داده ها را دوباره باز تولید کنند و این کار می تواند برای اطلاعات محرمانه خطراتی ایجاد کند.

بن کینگ، معاون اعتماد مشتری در شرکت امنیتی Okta (OKTA.O) می گوید: «مردم وقتی از خدمات هوش مصنوعی مولد استفاده میکنند نمیدانند چگونه از دادههای آنها استفاده میشود. اما، برای کسبوکارها اینطور نیست. کاربران معمولی سرویس های رایگان هوش مصنوعی برای شرکت ها نمی توانند خطری ایجاد کنند.» شرکت OpenAI در واکنش به این نظرسنجی و پیامدهای منفی استفاده از ChatGPT توسط کارمندان خودداری کرد. اما، به تازگی پستی در وب سایت خود منتشر کرد و در آن به شرکای خود اطمینان داد که از داده های آنها برای آموزش چت بات استفاده نمی کند مگر این که، آنها اجازه دهند.

چت بات Bard شرکت گوگل نیز زمانی که مردم از آن استفاده می کنند داده های آنها مانند متن، مکان و سایر اطلاعات شخصی را جمع آوری می کند. البته، کاربران می توانند تاریخچه مکالمات خود را با چت بات حذف کنند و حتی از گوگل بخواهند متحوای تایپ شده در هوش مصنوعی را حذف کند.

انجام وظایف بی ضرر

یکی از کارمندان آمریکایی شرکت Tinder گفت:« با و جود آنکه شرکت به صراحت استفاده از ChatGPT را ممنوع اعلام کرده است اما، کارگران در برنامه دوستیابی از آن برای انجام کارهای بی ضرری مانند نوشتن ایمیل استفاده می کنند.

رویترز نتوانست به علت محرمانگی این اطلاعات، نحوه استفاده کارکنان Tinder از ChatGPT را تأیید کند. اما Tinder گفت که دستورات مشخصی برای کارمندان خود در زمینه رعایت امنیت و داده در نظر گرفته است.

در ماه مه سال جاری نیز شرکت Samsung Electronics استفاده از ChatGPT و سایر ابزارهای مشابه را برای کلیه کارمندان خود در سراسر جهان ممنوع اعلام کرد. این تصمیم پس از آن گرفته شد که یکی از کارمندان این شرکت کره ای کد حساسی را در پلتفرم شرکت openAI آپلود کرده بود. سامسونگ در بیانیه 3 آگوست گفت: "ما در حال انجام اقداماتی برای ایجاد یک محیط امن برای استفاده از هوش مصنوعی مولد هستیم که میزان بهره وری و کارایی کارمندان را افزایش می دهد. با این حال، تا زمانی که این اقدامات انجام شود، به صورت موقت استفاده از هوش مصنوعی مولد را محدود می کنیم." طبق گزارش رویترز در ماه ژوئن، آلفابت نیز به کارمندان خود در مورد نحوه استفاده از چت بات های هوش مصنوعی از جمله بارد هشدار داد.